在之前介绍了 Index-TTS2,它是 Bilibili 开源的文本生成语音大模型,开源模型除了没有提供商业模型输出时长可控的特性,整体而言是目前中英文混合语音合成效果最好的模型之一,特别是在低样本音色克隆和情感可控方面。

本文介绍另外两个模型与 Index-TTS2 之间的对比,之所以选择 index-TTS2、CosyVoice、Melo-TTS 模型进行评测,主要是基于开源、本地运行、支持中英文的条件下所作的选择。

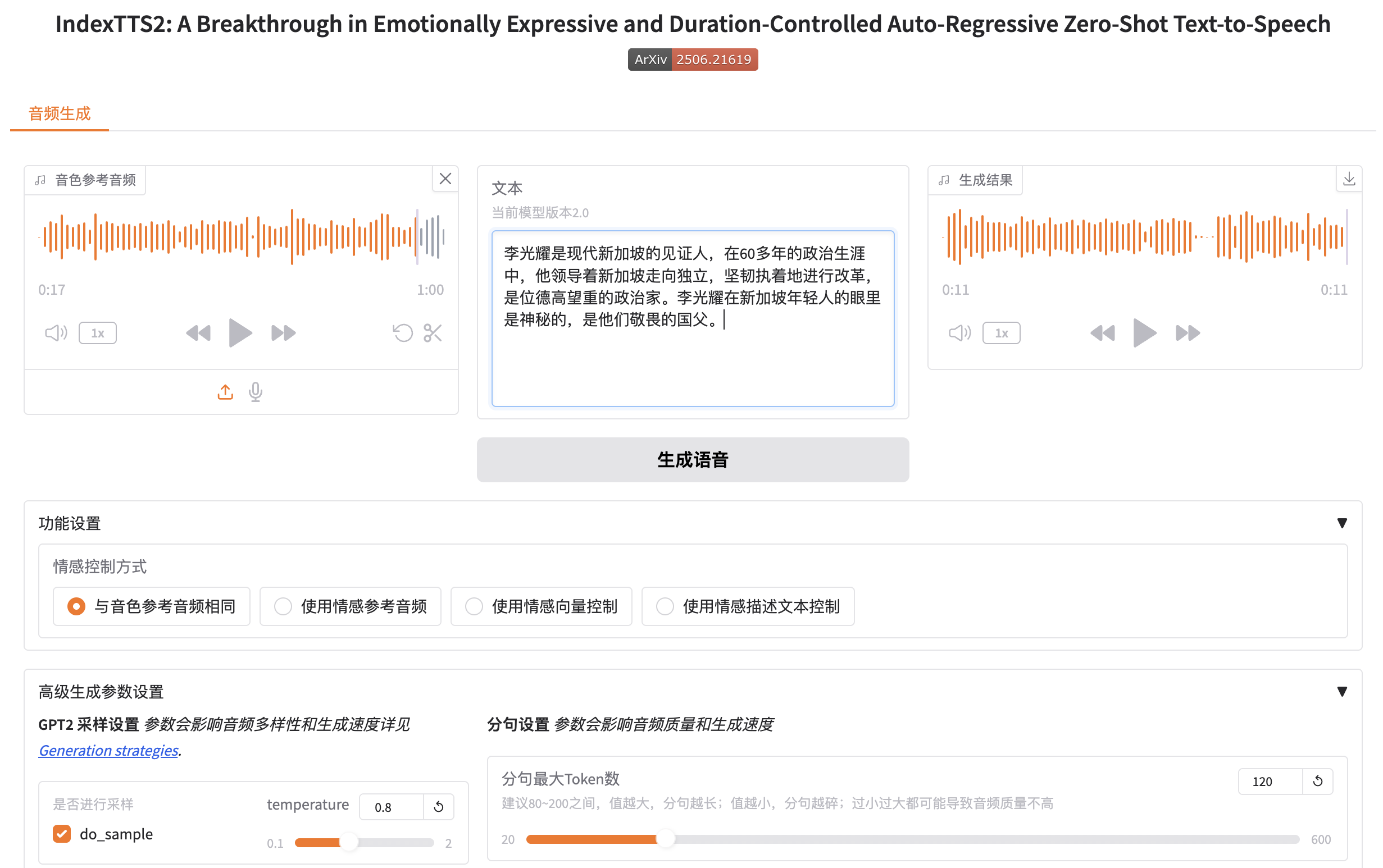

Index-TTS2

由于前文已经有更详细的介绍,可以参考前文描述。这里只补充一下本地生成的实际效果,他是目前实测中语音合成质量最好的模型。

合成性能方面,作者使用 Index-TTS2 合成一本时长 26 小时的语音书,在 Mac M1 Max 64G 上总耗时 50+ 小时,合成时长耗时比例约 2.3 : 1。 而在 3060 12G GPU 上耗时接近,而长文本耗时更长(可以通过修改断句来提高长文本耗时)。

CosyVoice

CosyVoice 是阿里通义语言团队开源的音频基座大模型 FunAudioLLM 中的一部分(包括SenseVoice - 多语言音频理解,和CosyVoice - 多语言音频生成),目前版本为 3.0。

因为自己不是专业做模型评测的,这里直接放自己实测的主观体验结论,CosyVoice 在 TTS 语音合成音色方面接近或略逊于 Index-TTS2 ,情感控制方面不如 Index-TTS2。合成性能初步评估也更低。

易用性方面,官方给出的 web UI需要手工输入样本对应的文本,这方面会使 CosyVoice 在实用性上与 Index-TTS2 进一步拉开距离。

由于音色与合成性能的原因,很遗憾在实用性方面比较难应用于实践场景,或者可以继续观察有没有更小体量的模型放出,以达成合成质量与性能之间的平衡。

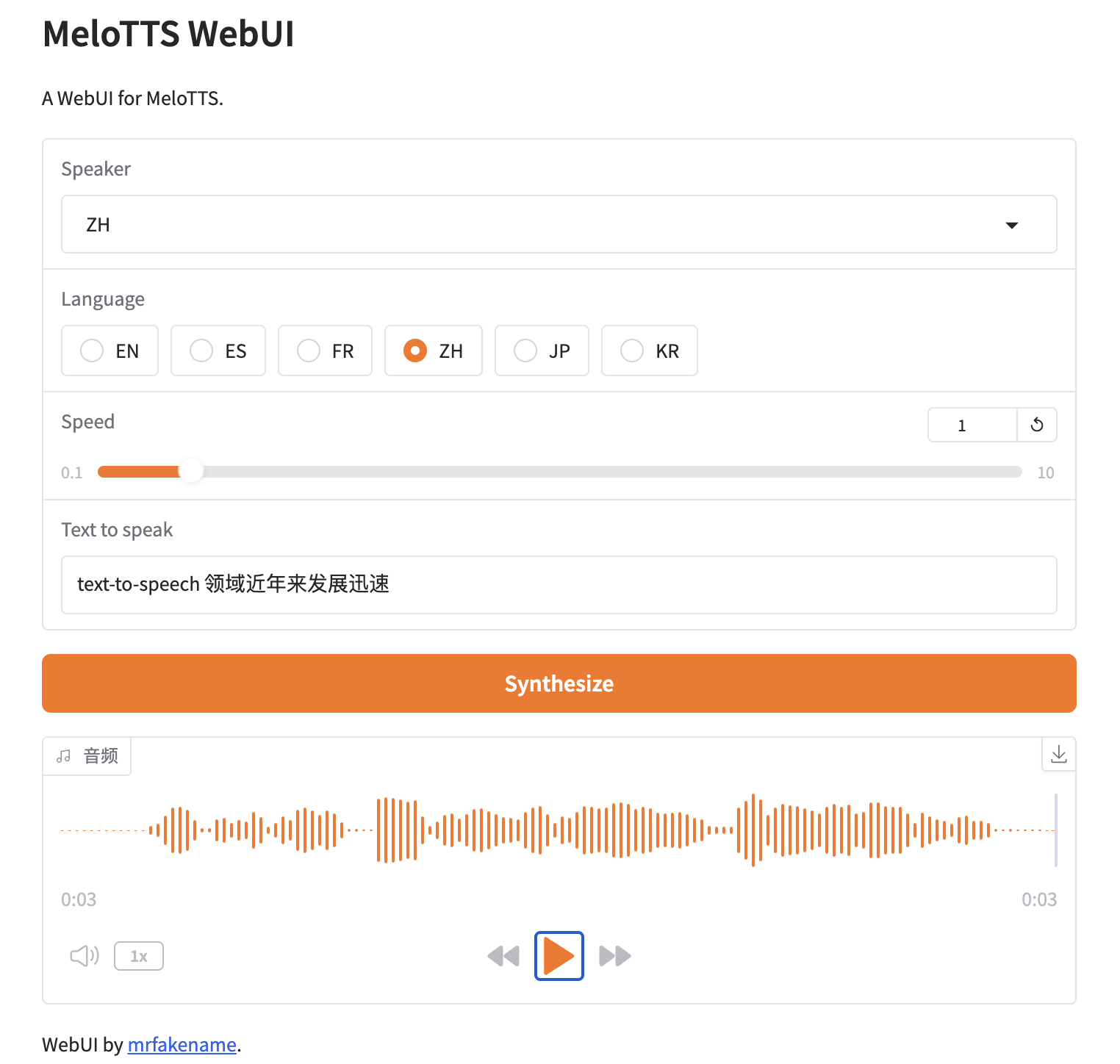

Melo-TTS

Melo-TTS 是由 MIT 和 MyShell.ai 发布的开源多语言TTS模型。

实测结论,在语音合成质量方面,Melo-TTS 与前两者还有较大的差距,不支持音色克隆和情感控制。

但是 melo-TTS 最大的优势在于语音合成性能方面,可以做到 1:1 以内的合成速度,即除了秒级的首句延迟以外,可以做到不间断的语音合成输出,从而在实用性方面弥补了前两者的不足。

另外值得一提的是,Melo-TTS似乎代码内提供了一个看起来效果还不错的断句能力(可以切分为较短的句子),这在很多场景中是比较实用的一个特性,或许相比之前 Vibe coding中 AI 为我生成的基于正则的断句效果会更好一些,抽空再深究好了。